Fotómetros e ISOs

Un nuevo capítulo del libro de Jesús Haro, Mi próxima película es digital, ¿y ahora qué?

Autor: Jesús Haro

En el mundo de la captación digital se abandona el uso del fotómetro en aras de herramientas más ‘digitales’ o propias del tipo de captación que realizamos como puedan ser el False Color, el Histograma, el Monitor o el Monitor Forma de Onda. Sin embargo, el fotómetro permite junto con una herramienta tan simple como una carta gris del 18% correctamente expuesta tener un punto de referencia en un modo de trabajo familiar a los directores de fotografía, de modo que pueden realizar sus evaluaciones sensitométricas del nuevo medio de captación con el que rodarán su próximo proyecto.

Días atrás, si uno quería tal o cual look diferente, el director de fotografía elegía una u otra emulsión o proceso fotoquímico y hacía sus pruebas para familiarizarse, por ejemplo, con un resultado no estandarizado. También, si el director de fotografía quería o, mejor dicho, necesitaba más o menos sensibilidad en su material fotosensible, cambiaba la emulsión por otra con las características adecuadas. Léase aquí en estos dos casos que la cámara seguía siendo la misma.

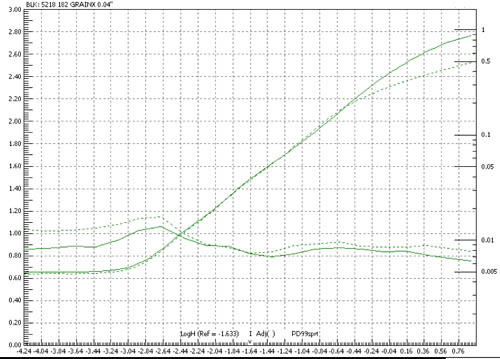

A la vista de todo ello, fabricantes como Kodak, por ejemplo, ponían un gran empeño en tener diferentes emulsiones de distinta sensibilidad en la paleta de trabajo de los directores de fotografía. Eso sí, dentro de lo que ellos llamaban la misma familia de producto. Tuvimos así la EXR, la Vision, la Vision2 y más recientemente la Vision3. Todas ellas en una misma familia compartían las mismas características de comportamiento tonal, rango dinámico o reproducción del color aún con diferentes sensibilidades o apariencia de grano.

>> Curvas de respuesta sensitométrica y granularidad publicadas por Kodak para la Vision3 5218 (línea de puntos) vs la Vision3 5219 (línea contínua)

Y eso de las familias de producto era algo vital, porque el director de fotografía fue siempre reacio a cambiar la herramienta que tan buenos resultados le daba por otra con la que no tenía familiaridad. Él sabía hasta dónde podía llegar de oscuridad o en las altas luces teniendo el detalle adecuado y jugando con su memoria visual y su fotómetro, y podía hacer las predicciones necesarias sobre los niveles de exposición, la calidad de los negros o la apariencia final de la imagen. Así, si un nuevo miembro de la familia salía al mercado era necesario poner todo a prueba de nuevo: luz, pieles, emulsión, fotómetro y laboratorio. Todo el proceso para que sus predicciones siguieran funcionando. Por eso Kodak y Fuji con cada nuevo lanzamiento de emulsión ofrecían siempre la posibilidad al director de fotografía de hacer sus pruebas.

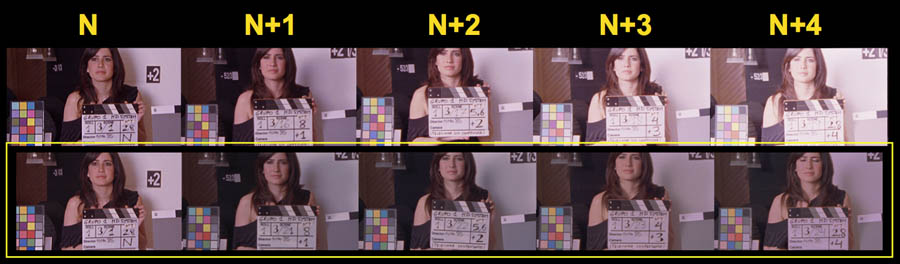

Estas pruebas consistían fundamentalmente en la exposición correcta de un personaje rodeado de ‘cosas’ blancas, brillantes y negras. Y por supuesto con una carta gris, otra de color llamada ‘la Macbeth’ y algunos detalles al gusto personal. La prueba incluía además el rodaje de diferentes tomas, exponiendo esa escena abriendo y cerrando el diafragma de medio en medio punto. Luego, ese material era copiado ‘a una luz’ y se hacía también una segunda copia etalonada intentando recuperar algunos de los diferentes niveles de sub y sobrexposición para ver hasta dónde se podía llegar en caso de error de exposición y por supuesto su precio en calidad de imagen. Así es pues como un director de fotografía construye una galería de imágenes de referencia en su imaginario personal del que ‘tirará’ al rodar su película situando la exposición en el nivel que desea haciendo una predicción de cómo se verá en la pantalla.

>>Exposición a diferentes niveles y corrección posterior de algunos de ellos intentando igualarlos a la exposición normal para ver la Latitud.

De la medida de la densidad de ese gris neutro que incluimos en la imagen podemos obtener una curva de respuesta de ese material sensible a la luz. En realidad, podíamos pedir al laboratorio una tira de pruebas expuesta en un sensitómetro, procesarla y luego medir la densidad; sin embargo, de este modo solo tenemos una escala numérica y ni ponemos a prueba nuestro fotómetro ni tenemos una imagen de cómo se reproducen los tonos y los colores.

>>Tira de pruebas hecha por Tomás Pladevall en su Master de Cinematografía en la ESCAC. Como el rango de la Vision3 excede la capacidad de una sola tira, hubo que hacerlo con dos rangos de exposición utilizando un filtraje para conseguir la curva completa.

Hoy las cosas son algo diferentes. Como ya hemos dicho, una diferencia fundamental es que cada cámara podría ser considerada una emulsión diferente o incluso una familia de emulsiones diferentes. Si un director de fotografía quisiera uno u otro look, parece que debería elegir una u otra cámara.

Pero no es tan simple. Los fabricantes hablan de la sensibilidad de sus cámaras en términos diferentes que provienen del mundo de la ingeniería y no de la cinematografía. Además, es engañoso el modo en el que nos hablan de esa sensibilidad a la que llaman nominal cuando luego nos dicen que podemos cambiarla a voluntad sin decirnos con claridad lo que ocurre.

Así, nos enfrentamos quizás a dos modelos básicos cuando hablamos de la sensibilidad que nos dicen que tienen las diferentes cámaras: El primero es aquél en el que la grabación es raw y la cámara posee una sensibilidad nominal o nativa elegida por el fabricante de manera que obtendremos, en el caso de hacer nuestras pruebas al modo tradicional, una serie de valores por encima del gris medio con detalle y otros por debajo. El segundo es aquél en el que, si variamos la sensibilidad de la cámara, ésta aplica en ese momento una serie de ganancias para colocar el nivel en su lugar correcto y el archivo queda así grabado.

Así, nos enfrentamos quizás a dos modelos básicos cuando hablamos de la sensibilidad que nos dicen que tienen las diferentes cámaras: El primero es aquél en el que la grabación es raw y la cámara posee una sensibilidad nominal o nativa elegida por el fabricante de manera que obtendremos, en el caso de hacer nuestras pruebas al modo tradicional, una serie de valores por encima del gris medio con detalle y otros por debajo. El segundo es aquél en el que, si variamos la sensibilidad de la cámara, ésta aplica en ese momento una serie de ganancias para colocar el nivel en su lugar correcto y el archivo queda así grabado.

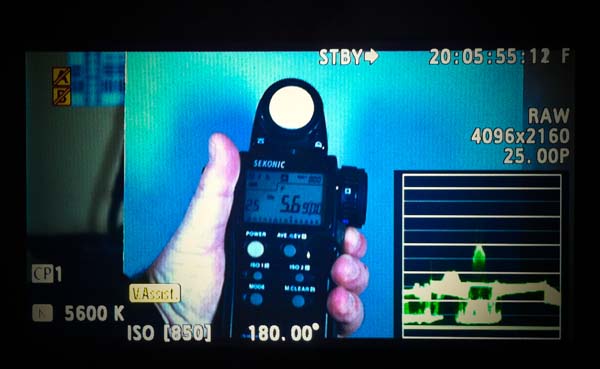

A la hora de hacer nuestras pruebas de exposición expondremos entonces un gris neutro. Pero podemos hacer dos cosas, o bien colocamos la exposición del gris donde nos dice el fabricante que debe estar utilizando el forma de onda o el false color proporcionado por la cámara, o bien expondremos con nuestro fotómetro como hemos hecho siempre a lo que nos pida para una determinada sensibilidad y luego veremos dónde ha caído ese valor de gris medio.

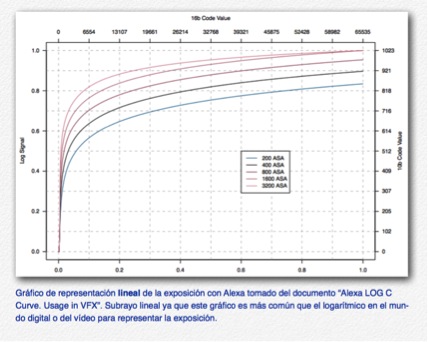

Podemos construir entonces nuestra curva como hemos visto tomando nuestras medidas y así poder predecir un comportamiento. Las medidas digitales las tomaremos en una escala de 10 bits con un picker e iremos ‘ploteando’ una gráfica colocando en el eje ‘x’ nuestra exposición en pasos (escala logarítmica) y en el eje ‘y’ pondremos el logaritmo en base 10 del code value obtenido ya dividido por 1023. Por ejemplo, para un valor de Cv 400 que es el que nos dice Arri para el nivel de gris en la Alexa, sería Log10(400/1023)= 0,391.

¿Pero qué ocurre si variamos la sensibilidad?

Si lo hacemos en el primer modelo, lo que hacemos es simplemente darle una orden de revelado y, por supuesto, si pasamos de considerar un 800 ISO a un 1600ISO en nuestro fotómetro lo que estamos haciendo es desplazar nuestro gris medio hacia abajo en la exposición y la indicación en cámara de que ha sido rodado a 1600 le está dando una orden de revelar o ‘debayerizar’ esa pieza ‘forzando’ el revelado un punto para que el gris esté más arriba en el lugar que le debe corresponder. Así, no es que la cámara tenga varias sensibilidades, sino que en cierto sentido ‘fuerza’ el revelado por utilizar un símil de fotoquímico. Los fabricantes nos hablan entonces de ISO efectivo , que sería el que estamos usando en un momento particular.

Así, como ya apuntamos en la sección sobre la Alexa, el uso de una ISO ‘flotante’, como la llama Alfonso Parra, o efectiva, como se llama en otras ocasiones, tiene tres efectos:

El primero es el posible nivel de ruido producido porque, cuando se vea la imagen capturada, se le aplicarán ganancias a la imagen para situar ese gris medio donde le corresponde después de haberlo subexpuesto en rodaje. Ese nivel de ruido se puede medir, pero siempre es vital una inspección visual del resultado al nivel de magnificación o en las condiciones de visionado que vayan a ser para una imagen en concreto. No es lo mismo una pantalla de cine que una imagen en un ordenador. Y, por supuesto, es importante conocer el grado de actuación posterior que sobre la imagen se quiere tener. Es decir, si vamos a buscar una corrección de color extrema el nivel de ruido puede darnos más problemas. En cualquier caso, es importante notar que es más sencillo trabajar o actuar sobre el nivel de ruido con programas sofisticados que hay hoy en el mercado que luchar contra la falta de información tanto en las altas luces como, y esto está más relacionado con el ruido electrónico, en las zonas de oscuridad. Recordemos que si no hay información de imagen y solo hay ruido, será muy difícil rescatar lo que no existe.

El primero es el posible nivel de ruido producido porque, cuando se vea la imagen capturada, se le aplicarán ganancias a la imagen para situar ese gris medio donde le corresponde después de haberlo subexpuesto en rodaje. Ese nivel de ruido se puede medir, pero siempre es vital una inspección visual del resultado al nivel de magnificación o en las condiciones de visionado que vayan a ser para una imagen en concreto. No es lo mismo una pantalla de cine que una imagen en un ordenador. Y, por supuesto, es importante conocer el grado de actuación posterior que sobre la imagen se quiere tener. Es decir, si vamos a buscar una corrección de color extrema el nivel de ruido puede darnos más problemas. En cualquier caso, es importante notar que es más sencillo trabajar o actuar sobre el nivel de ruido con programas sofisticados que hay hoy en el mercado que luchar contra la falta de información tanto en las altas luces como, y esto está más relacionado con el ruido electrónico, en las zonas de oscuridad. Recordemos que si no hay información de imagen y solo hay ruido, será muy difícil rescatar lo que no existe.

Como segundo efecto, suele ocurrir también que hay un efecto colateral que es que hay cierta variación de la gamma al rodar con la cámara ajustada a diferentes sensibilidades, teniendo a veces un contraste perceptiblemente mayor en las sombras para sensibilidades más altas, ya que se trata de enmascarar un nivel de ruido mayor.

Ocurre que para cada ISO los fabricantes diseñan curvas de respuesta a la luz ligeramente diferentes. Sobre un archivo raw quizás no es mayor problema, pero sí lo es sobre un archivo codificado con un ProRes, por ejemplo, ya que ese ISO al que se ha rodado y las características de esa curva de exposición quedan embebidos en el archivo mismo. Lo que puede ocurrir es que archivos rodados a diferentes sensibilidades puede que monten mal en términos de continuidad de contraste o gamma y haya que trabajar un poco más para igualarlos.

En este modelo tendríamos entonces que hacer una prueba de exposiciones para cada ISO utilizado si queremos hacer bien nuestras previsiones. O al menos con la sensibilidad que vayamos a utilizar. Sin embargo, me parece más simple rodar al mismo ISO con el que estemos acostumbrados y pensar en términos de exposición si estamos subexponiendo de modo voluntario o no con nuestro fotómetro, sabiendo que luego vamos a poder corregir esa subexposición hasta cierto punto. Que conste que es un caso extremo lógicamente, ya que lo ideal sería poner más luz y no subexponer. Pero todos sabemos que muchas veces lo que prima es ‘llevarse’ el plano.

Ocurre también que uno pueda querer desplazar el punto de la exposición utilizando el ISO para sacar más partido a las altas luces o tener más detalle en las sombras. En realidad se trata simplemente de exponer para las luces o para las sombras, lo que siempre hemos hecho prestando atención al fotómetro y a la luz de la escena. Podemos redistribuir entonces nuestro rango en función de la escena a exponer. Si en vez de 800ISO me decanto por 200ISO estaré en una situación en la que ahora por abajo tendré más stops y menos por arriba. Si al contrario, decido trabajar a 3200ISO, estaré jugando con más stops en las altas luces y menos en las sombras, aunque tendré una ligera cantidad de ruido dependiendo de donde exponga mis zonas oscuras.

Pero ocurre entonces un fenómeno que es un cambio de hábito necesario. ¿No sería lo normal utilizar una emulsión de baja sensibilidad para exteriores cuando hay mucha luz y una de alta sensibilidad cuando no hay luz? Claro que sería lo normal. Pero la realidad es que tenemos una única sensibilidad, la que sea, pero hoy ésta es generalmente alta, y si jugamos a bajarla en una cámara de este tipo lo que ocurrirá es que estaremos exponiendo para las sombras, sobreexponiendo, colocando el gris medio más arriba, con lo que perderíamos rango dinámico en las luces, y a veces demasiado pronto dependiendo de qué cámara se trate. ¿Y si estamos en una escena nocturna y exponemos a muy alta sensibilidad? Lo que ocurrirá es que estaremos exponiendo para las luces, subexponiendo, y perderemos rango dinámico en las zonas oscuras demasiado rápido. Vemos así que hay que cambiar el ‘chip’, el modo de pensar. Sin embargo, es muy simple si lo pensamos en términos de exponer donde deseemos dando prioridad a las luces o a las sombras. En cámaras con rango tan extenso como la Alexa no es un problema mayor, pero en una RedOne por ejemplo el problema puede dar como resultado imágenes muy lejos de lo ideal.

¿No estaría bien por otro lado que los fabricantes sacaran al mercado bloques con la montura y el sensor que fueran intercambiables y proporcionaran diferentes sensibilidades a una cámara? Bueno, no parece que los ‘tiros’ vayan por ahí.

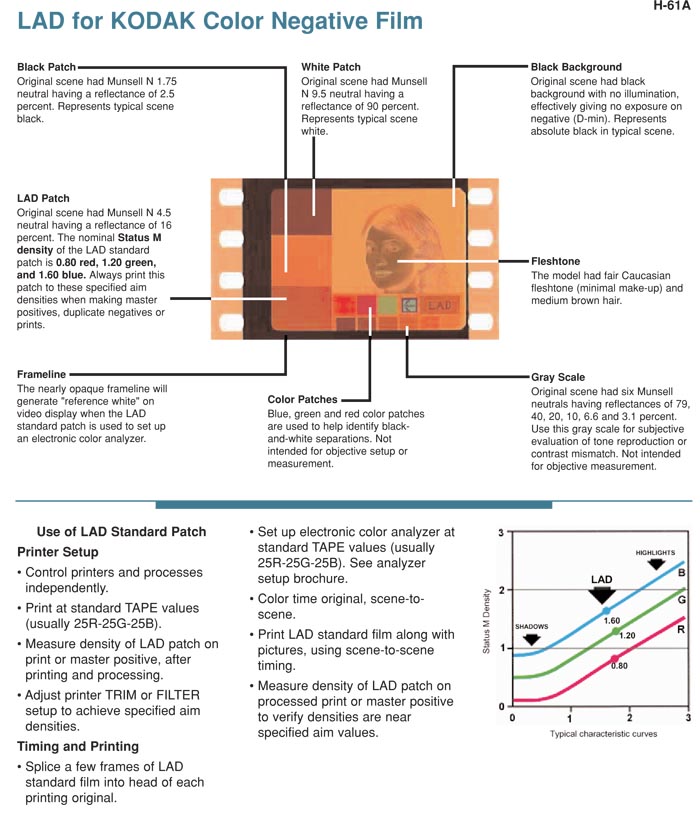

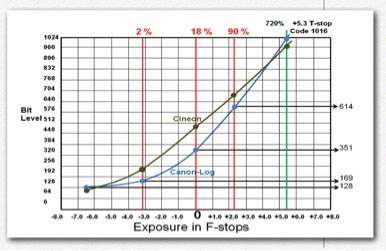

Para añadir un poco más de dificultad, ocurre que cada fabricante no solo construye la curva de respuesta según su criterio para optimizar la exposición, sino que coloca el gris neutro en un lugar diferente para optimizar eso que llaman sensibilidad nominal, de modo que tienes igual número de stops de exposición por arriba y por abajo. En el caso de la película negativa, el gris neutro siempre ha sido una referencia para la exposición correcta y para la copia, siendo la medida de su densidad un referente de calidad de la exposición (0.8 rojo, 1.2 verde y 1.6 azul, medidos con un densitómetro en Status M). Cuando comenzaron los procesos de intermediación digital en los que el negativo era escaneado, esa densidad debería corresponder a una medida en términos de profundidad de 10 bits a un valor de 470CV. Sin embargo, Kodak decidió colocarlo un poco más abajo y la medida de la densidad del gris de referencia digital se situó finalmente en 445cv.

Hoy Arri, por ejemplo, sitúa esa medida en 400CV, aún un poco más abajo. RedOne con su curva RedLog lo sitúa exactamente en esos 445cv, pero solo con esa curva, siendo la captura raw real un poco más oscura de este valor y, por supuesto, siempre referido a una sensibilidad concreta que es la del sensor que podríamos decir que es inferior a la que cabría suponer si medimos con la curva logarítmica.

En el caso de Canon, como ya hemos visto, el valor se sitúa en el 351cv y en el caso de Blackmagic Design CC aún más abajo, alrededor del 295. ¿Qué significa que estos valores estén tan abajo? Pues que, en realidad, para optimizar un rango mayor en altas luces estamos subexponiendo nuestros rostros a fotografiar. Solo si no atendemos al fotómetro y miramos un forma de onda y el monitor colocaríamos la exposición ‘a ojo’ más arriba, pero hemos de ser conscientes de que estaremos afectando al rango disponible en altas luces y puede que nuestra imagen no tenga la suavidad deseada en ese rango.

>>Curvas de exposición de diferentes cámaras y niveles para los que los fabricantes colocan el gris neutro. Los niveles 685 y 95 son los extremos entre el blanco con detalle y el negro de un archivo logarítmico.

¿Y qué podemos extraer de este hecho de colocar el gris más arriba o más abajo? En el caso de Arri, ese neutro le garantiza 7 stops por arriba y 7 stops por abajo. Recordemos que no hablamos aquí En el caso de la do en un grla fscalones de modo que distingamos un nivel de exposiciabajo. Recordemos que no hablamos aqua la fde ruido, sino solo de si se distinguen los escalones de modo que diferenciemos un nivel de exposición del otro, todo ello mostrado en un gráfico logarítmico. En el caso de la Canon, su nivel de gris está en un 351, lo que le proporciona un rango por arriba de unos 4 stops y medio y por debajo de unos 5 y medio. Antes, en el mundo de la película, si una curva estaba más o menos a la derecha o a la izquierda, significaba que era más o menos rápida o sensible. Hoy, aunque podemos hablar en esos términos, lo que en realidad está ocurriendo es que es un medio para optimizar el rango dinámico de la cámara. En el caso de la Blackmagic, por ejemplo, su gris neutro queda a 298 cvs. Si tratamos de colocarlo en el nivel para el que un gris nos parecería a la vista un gris, tendríamos que subir la exposición un punto o un punto y medio, lo que significa en términos de exposición que dicha cámara es más lenta de lo que dice o que su sensibilidad en vez de ser 800ISO es unos 320. Pero claro, si hacemos eso en la exposición estaremos perdiendo una enorme latitud en altas luces. El fabricante lo ha diseñado así para tener al menos 5 stops y medio por encima de ese gris manteniendo otro tanto de escalones de exposición bien diferenciados en las sombras, de modo que si mantiene un nivel de ruido razonable es sencillo etalonarlo subiéndolo con su propia herramienta. No en vano son los desarrolladores del DaVinci Resolve. En realidad el fabricante confía en lo que su cámara puede ofrecer por abajo más de lo que lo hace por arriba y sabe que es un proceso en dos pasos en el que el material hoy raw o similar será procesado y colorizado en un segundo paso.

Así, podemos buscar el símil de la exposición de material reversible cuando estamos ante este tipo de casos en los que es necesario subexponer para tener el rango suficiente en altas luces. Lo contrario sucede en la Alexa, con la que es necesario un razonable grado de sobrexposición ya que su latitud en las altas es muy grande y presenta algo de ruido visible en los escalones más bajos, ruido que a algunos les gusta para tener algo de textura en una imagen que de lo contrario es demasiado limpia. Es el único caso hasta hoy en el que podemos confiar plenamente en la exposición correcta con el fotómetro sabiendo que hay rango suficiente en altas luces. Quizás sea ésta la cámara más sencilla si un director de fotografía desea cambiar de la emulsión al mundo del rodaje digital sin cambiar su modo de pensar o sus herramientas habituales.

Volviendo al caso de las cámaras Canon C300 y C500 nos encontramos un modelo diferente en cuanto al cambio de sensibilidad. En ellas, la variación de la sensibilidad en cámara no sitúa el gris en un nivel más bajo o más alto. Lo que ocurre es que al no ser un raw auténtico y llevar parte del procesado incluído en el archivo (casi todo salvo el debayer: ‘raw al punto’ es el término que se ha acuñado para ello) al rodar con sensibilidades diferentes la cámara aplica una ganancia para colocar el gris en el lugar ideal. Es entonces una lucha entre ganancia y nivel de ruido producido por dicha ganancia, lo que se llama relación señal-ruido. Siendo en este caso la exposición más crítica en los niveles más oscuros ya que, aunque se mantiene ese rango dinámico, al aumentar la sensibilidad la relación señal-ruido cambia, se hace menor porque los peldaños más inferiores de esa curva pueden no ser usables en términos de información limpia de ruido.

>>En el gráfico adjunto podemos ver como las dos curvas de la C500, una a 800 y otra a 3200 ISO se solapan prácticamente. Solamente existe una pequeña diferencia, como hemos apuntado, de variación ligera del contraste en bajas luces y, por supuesto, un aumento del ruido que no vemos en este gráfico.

Así que, ¿cómo procedemos? Para optimizar la exposición no hay nada como la propia experiencia y, por supuesto, los aparatos de medida.

Hoy contamos, además de con nuestros fotómetros, con histogramas, indicadores de false color, semáforos como, en el caso de Red, que nos avisan del ruido o del recorte de la señal, o los tradicionales Zebra y forma de onda que con la debida transformación de IRES a CVs podemos trabajar con ellos. Sin embargo, ninguno de todos ellos proporciona por sí solo toda la información necesaria.

¿Defenderemos entonces el uso de los fotómetros? Bajo nuestro punto de vista, quizás en el set la velocidad necesaria o la presencia de otras herramientas más intuitivas permiten rodar sin necesidad de atender constantemente al fotómetro. Sin embargo, si queremos entender lo que está ocurriendo, el fotómetro junto con una carta gris sigue siendo una referencia ineludible. Creo que no podríamos haber analizado los conceptos de lo que hemos hablado en este capítulo sin un fotómetro, aunque luego en el set no sea necesario tenerlo tan a mano. En digital ya no es necesario hacer predicciones porque podemos monitorizar de modo más sencillo el resultado. Pero el comportamiento de un medio sensible a la luz necesita ser traducido en términos que un fotógrafo entienda. Luego cada uno utilizará para su arte la técnica que prefiera.